Feedforward Neural Network : les réseaux de neurones à action directe

Les Feedforward Neural Networks (FNN) sont des réseaux neuronaux simples qui transmettent exclusivement des informations d’une couche à la suivante. Ils sont divisés en FNN monocouche et FNN multicouche et ont différents domaines d’application dans le domaine du Deep Learning.

Qu’est-ce qu’un Feedforward Neural Network ?

Un Feedforward Neural Network (FNN), également appelé réseau de neurones à action directe en français, est un réseau neuronal composé de neurones artificiels et entièrement sans rétroaction. Ce type de réseau est considéré comme une forme particulièrement simple de réseau neuronal artificiel, car il agit toujours exclusivement dans une direction, sans rétroaction. Les réseaux neuronaux profonds à rétroaction sont un élément important pour la création de modèles dans le domaine du Deep Learning et de l’intelligence artificielle. Selon le nombre de couches utilisées (layer en anglais), on distingue les FNN monocouches et multicouches.

- Créez votre site Web en un temps record

- Boostez votre activité grâce au marketing par IA

- Gagnez du temps et obtenez de meilleurs résultats

Comment fonctionne un Feedforward Neural Network ?

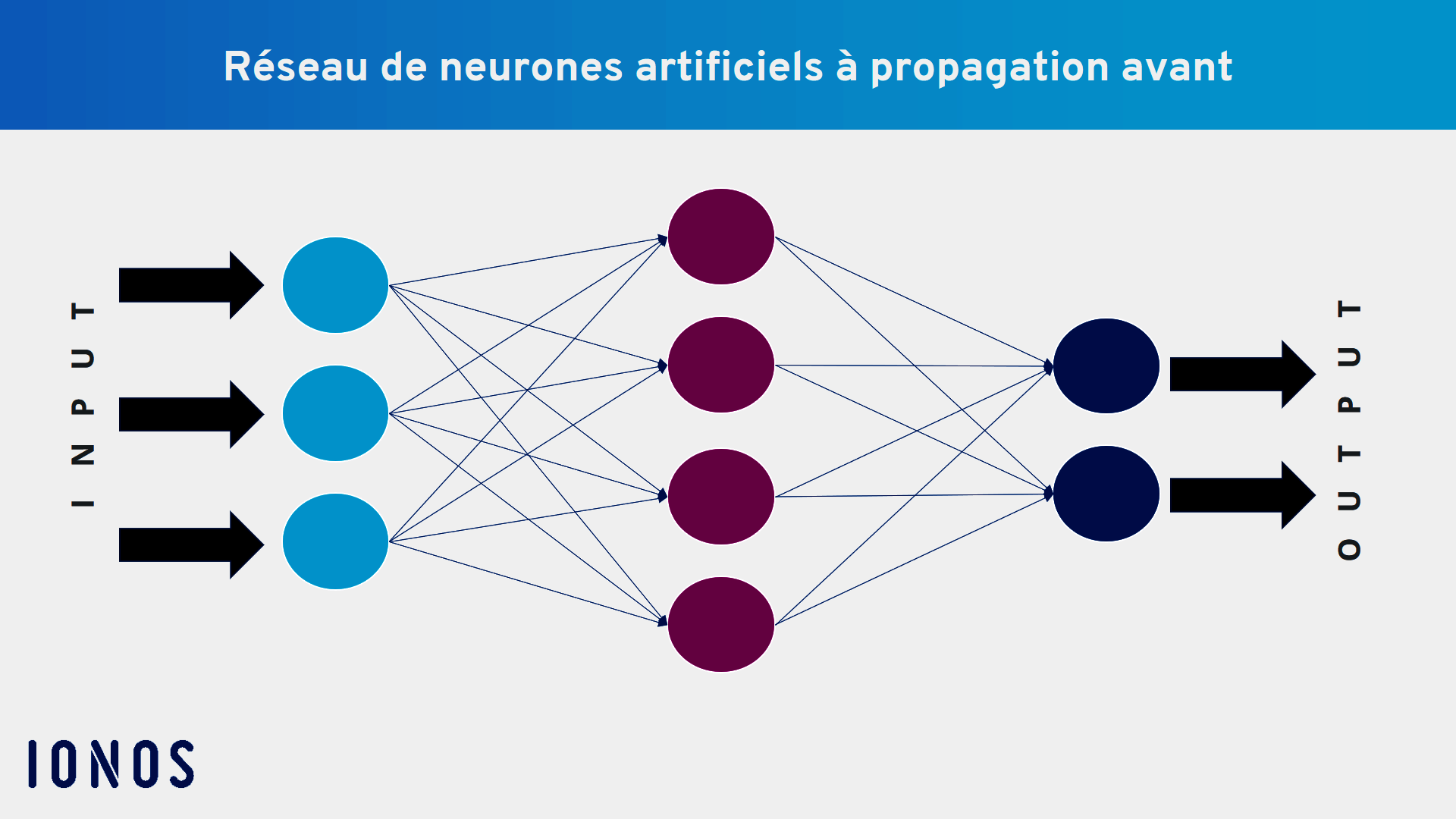

Comme pour tout réseau neuronal artificiel, le modèle du réseau de neurones à action directe s’inspirent vaguement du fonctionnement du cerveau humain, bien que leur architecture soit bien plus simplifiée. Celui-ci traite aussi les informations par le biais d’un réseau neuronal. Le FNN dispose d’au moins deux couches : une couche d’entrée (input layer) et une couche de sortie (output layer). Entre les deux, il peut y avoir d’autres couches (hidden layers) en nombre quelconque. Chaque couche est exclusivement reliée à la couche qui lui succède. Cette connexion se fait par des « arêtes ». Dans un Feedforward Neural Network, toutes les informations ne circulent que dans une seule direction, à savoir de la couche d’entrée vers la couche de sortie.

- La couche d’entrée : elle reçoit toutes les données d’entrée qui sont introduites dans le réseau neuronal. Chaque neurone de cette couche correspond à une propriété des données entrantes.

- Les couches cachées : des couches cachées peuvent se trouver entre la couche d’entrée et la couche de sortie. Chaque couche cachée est constituée de neurones interconnectés entre la couche précédente et la suivante.

- La couche de sortie : la couche de sortie donne le résultat final du Feedforward Neural Network.

Dans un Feedforward Neural Network, les données sont introduites dans la couche d’entrée, où chaque neurone représente une caractéristique spécifique des entrées. Ces neurones appliquent des poids synaptiques aux informations reçues avant de les transmettre. Dans un FNN à une seule couche, les données passent directement à la couche de sortie, tandis que dans un FNN à plusieurs couches, elles transitent d’abord par des couches cachées, où elles sont de nouveau pondérées et transformées. Comme ces transformations intermédiaires ne sont pas visibles, on parle de couches cachées.

Tout au long du processus, les valeurs pondérées sont cumulées à chaque étape. Une fonction d’activation est ensuite appliquée pour déterminer si un neurone doit transmettre une information ou non. Dans certains cas, une valeur seuil est utilisée pour cette décision. Dans un Feedforward Neural Network, les connexions sont strictement unidirectionnelles, reliant uniquement une couche à la suivante sans rétroaction.

Quels sont les principaux domaines d’application ?

Il existe de nombreux domaines d’application possibles pour les Feedforward Neural Networks. Les réseaux présentent de nombreux avantages, notamment lorsqu’il s’agit de traiter et de relier de grandes quantités de données non structurées. Voici quelques domaines d’application possibles :

- la reconnaissance et le traitement de la parole : les réseaux de neurones à action directe peuvent être utilisés pour convertir du texte en langage parlé ou pour convertir du langage parlé en texte.

- la reconnaissance et le traitement d’images : on peut analyser des images et en extraire des caractéristiques, par exemple en numérisant et reconnaissant des écritures manuscrites.

- la classification : à l’aide d’un Feedforward Neural Network, les données peuvent être classées en fonction de paramètres définis.

- la prédiction : les FNN peuvent aussi être utilisés pour la prédiction d’événements ou de tendances, par exemple en finance et météorologie. Ils sont utilisés entre autres pour les prévisions météorologiques ou dans différents systèmes d’alerte précoce dans les domaines de la protection contre les catastrophes, de l’espace et de la défense.

- la détection des fraudes : les Feedforward Neural Networks peuvent jouer un rôle important dans l’identification d’activités ou de modèles frauduleux.

Quelle est la différence avec un Recurrent Neural Network (RNN) ?

Le contraire d’un Feedforward Neural Network est le Recurrent Neural Network (RNN). Celui-ci fonctionne certes de manière fondamentalement similaire et transmet des informations sur les neurones de la couche initiale à la couche finale, mais peut également les renvoyer. Dans un tel réseau, des connexions récurrentes permettent aux informations de circuler non seulement vers l’avant mais aussi de revenir aux couches précédentes, ce qui permet au réseau de conserver un certain historique des données traitées.

Les réseaux de ce type sont surtout utilisés lorsque le contexte est important dans la recherche de résultats. Cela est particulièrement utile pour le traitement du langage, où le contexte est crucial. Par exemple, le mot « opéra » peut désigner un genre musical, un bâtiment ou une pâtisserie ; un RNN permet d’interpréter correctement le mot en fonction du contexte de la phrase.