Qu’est-ce que la reconnaissance vocale IA ?

La reconnaissance vocale IA permet aux ordinateurs de comprendre le langage humain et de le convertir en texte en temps réel. Elle constitue la base des assistants vocaux modernes, des fonctions de dictée et de la communication client automatisée.

Que signifie la reconnaissance vocale IA et comment fonctionne l’Automatic Speech Recognition (ASR) ?

La reconnaissance vocale IA, également appelée Automatic Speech Recognition (ASR), convertit la parole en texte lisible par machine. Pour cela, le système analyse d’abord le signal audio et identifie des caractéristiques acoustiques telles que les fréquences, la hauteur ou le volume. Ces éléments sont ensuite transformés en unités phonétiques, c’est-à-dire les plus petites composantes sonores de la langue.

Les systèmes ASR s’appuient sur des modèles statistiques et sur l’intelligence artificielle pour prédire les mots et les structures de phrases. En amont, ils sont généralement entraînés sur de vastes bases de données vocales afin de reconnaître des schémas linguistiques et d’en déduire des relations sémantiques. Les systèmes apprennent également de leurs erreurs : plus ils traitent d’exemples de parole, plus la reconnaissance gagne en précision et plus l’IA convertit la parole en texte de manière fiable. Enfin, le texte reconnu est généré en temps réel ou préparé pour d’autres processus d’IA. Ainsi, les requêtes adressées aux assistants vocaux ou aux chatbots vocaux IA peuvent être directement comprises et traitées.

Les approches modernes reposent de plus en plus sur des architectures dites end-to-end, les modèles RNN-Transducer (RNN-T) ou les architectures de type Transformer. Elles combinent directement les informations acoustiques et linguistiques dans un même processus, ce qui permet une meilleure prise en compte du contexte et une réduction significative du taux d’erreur par rapport aux méthodes classiques.

- Prend des rendez-vous, conseille, transfère des appels

- Répond immédiatement, jour et nuit

- Intégration facile dans les systèmes existants

- Essai gratuit

Quelles sont les technologies derrière la reconnaissance vocale IA ?

La reconnaissance vocale IA repose sur plusieurs technologies complémentaires qui permettent d’analyser, d’interpréter et de convertir la parole en texte. Voici les principaux composants de ces systèmes.

Réseaux neuronaux

Les réseaux neuronaux constituent le cœur de la reconnaissance vocale IA moderne. Ils se composent de neurones artificiels interconnectés capables d’apprendre à identifier des motifs dans les données audio. Un réseau neuronal peut, par exemple, reconnaître des séquences sonores récurrentes ou des intonations typiques. Grâce à un entraînement sur de vastes ensembles de données vocales, ces réseaux apprennent à distinguer des sons proches, comme « b » et « p », et à segmenter la parole de manière fiable.

Deep learning

Le processus de deep learning repose sur des réseaux neuronaux multicouches, appelés « Deep Neural Networks », pour identifier des relations complexes dans la parole. Les algorithmes classiques atteignent ici leurs limites, car la langue varie fortement selon la personne qui parle, le dialecte, l’accent ou les bruits de fond. Le deep learning permet de modéliser cette complexité, de détecter des motifs dans de grands volumes de données et de traiter également des variantes linguistiques inconnues.

Extraction de caractéristiques

Avant toute analyse, le signal audio brut doit être transformé en caractéristiques exploitables. Cette étape, appelée extraction de caractéristiques, permet d’isoler les éléments pertinents pour la reconnaissance :

- Formants : fréquences clés pour identifier les voyelles

- Spectrogrammes : représentation des fréquences dans le temps

- MFCC (coefficients cepstraux en fréquence Mel) : synthèse mathématique des informations sonores essentielles

Ces caractéristiques réduisent la quantité de données et mettent en évidence les informations pertinentes pour la parole, afin que l’intelligence artificielle puisse effectuer la reconnaissance vocale IA de manière efficace.

Modèles de langage

Les grands modèles de langage comme GPT sont souvent utilisés pour le post-traitement ASR et combinent l’analyse acoustique avec des connaissances contextuelles. Ils prédisent quels mots sont susceptibles de se suivre et quelles structures de phrases ont du sens. Cela permet au système de comprendre correctement le sens, même lorsque certains mots sont prononcés de manière peu claire ou qu’il existe des bruits de fond. Les modèles de langage sont essentiels pour transformer la simple conversion des sons en texte en résultats également cohérents sur le plan sémantique.

Natural Language Processing (NLP)

L’ASR seul convertit la parole en texte. La technologie du Natural Language Processing va plus loin en analysant le sens. Le NLP identifie les intentions, le contexte et les structures de phrases, évalue les relations grammaticales et permet, par exemple, le traitement des commandes dans les assistants vocaux ou la recherche sémantique dans les transcriptions. En combinant ASR et NLP, les systèmes d’IA peuvent non seulement reconnaître les mots, mais aussi comprendre l’intention qui les sous-tend.

Quels facteurs déterminent la qualité de la reconnaissance vocale IA ?

La précision de la reconnaissance vocale IA dépend de plusieurs facteurs clés. Même de légères variations de prononciation, de volume ou d’environnement peuvent influencer les résultats.

Langue et dialecte

Chaque langue possède ses propres schémas sonores, règles grammaticales et séquences de mots typiques. C’est pourquoi les systèmes ASR nécessitent généralement des modèles spécifiques pour chaque langue. Les dialectes au sein d’une même langue représentent un défi supplémentaire pour la reconnaissance vocale IA : les mots sont prononcés différemment, certaines syllabes peuvent être avalées ou accentuées, et certains termes varient selon les régions.

Accents

Les accents modifient la prononciation de certains sons et syllabes. Des locuteurs internationaux ou de régions différentes peuvent articuler les mots différemment, ce qui peut poser problème à un système entraîné uniquement sur une prononciation standardisée. Une grande précision de reconnaissance nécessite donc des données d’entraînement couvrant le plus grand nombre possible d’accents.

Bruits ambiants

Les bruits de fond, comme la circulation, les conversations dans la pièce ou les bruits mécaniques, altèrent également les caractéristiques acoustiques de la parole. La réverbération ou des microphones de mauvaise qualité peuvent dégrader le signal. Les systèmes ASR peuvent en partie compenser ces perturbations grâce à la réduction du bruit et au filtrage, mais dans des environnements particulièrement bruyants, le taux d’erreur augmente. Ainsi, une IA dans un centre d’appel doit par exemple traiter simultanément des voix, des bruits de clavier et le bruit de la climatisation.

Variabilité linguistique

Le volume, la vitesse d’élocution ou la hauteur de voix influencent la reconnaissance. Une parole rapide, peu audible ou émotionnelle peut être plus difficile à interpréter. Les variations liées au stress, à l’accentuation ou à l’intonation compliquent la transcription.

Qualité d’enregistrement

La qualité technique joue un rôle déterminant. Le type de microphone, la fréquence d’échantillonnage ou la compression du signal influencent directement la précision. Des équipements de qualité offrent un signal audio plus clair, tandis que des connexions téléphoniques ou du matériel basique peuvent introduire des distorsions.

Quels sont les domaines d’application typiques de la reconnaissance vocale IA ?

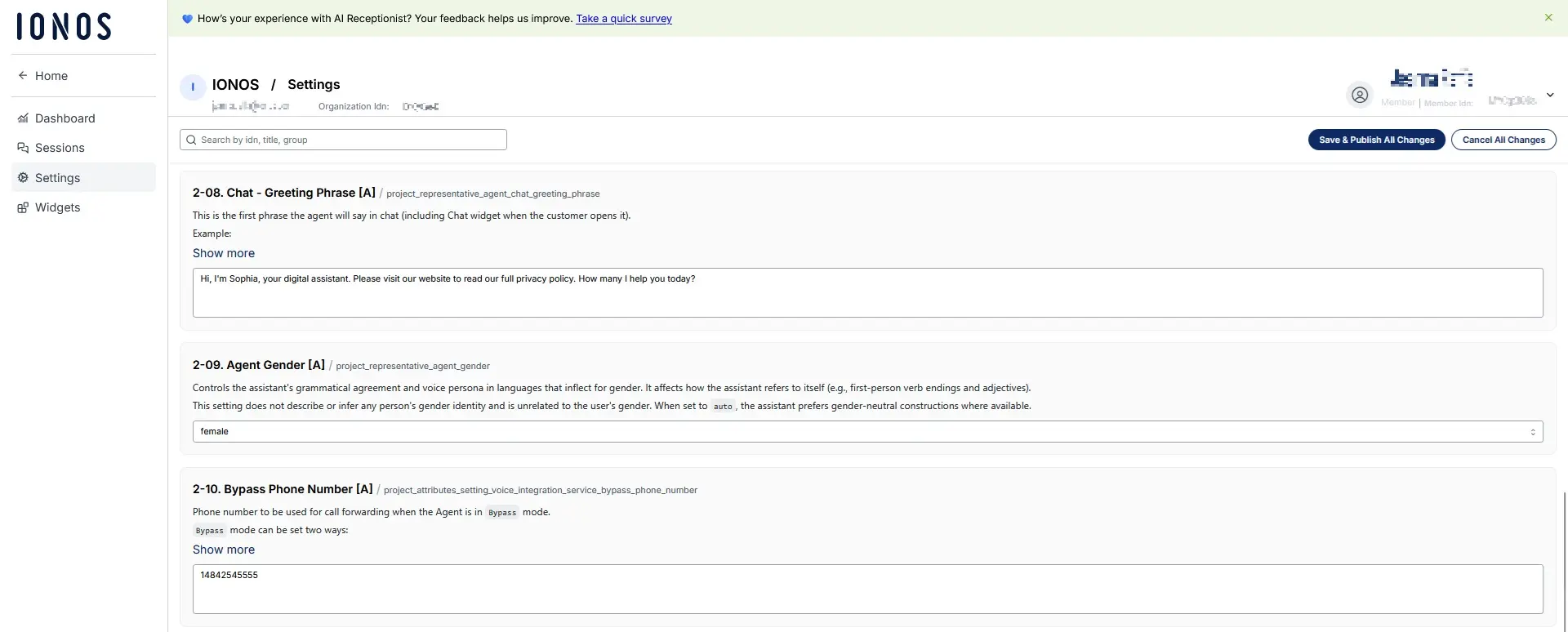

La reconnaissance vocale IA est aujourd’hui utilisée dans de nombreuses applications, aussi bien dans le quotidien que dans les environnements professionnels. Des solutions comme la solution de réceptionniste IA de IONOS illustrent concrètement comment les entreprises peuvent automatiser et optimiser leur communication.

Fonctions de dictée

Les outils de dictée permettent de convertir la parole en texte en temps réel. Ils facilitent la rédaction d’emails, de rapports ou de notes et améliorent l’accessibilité. Grâce à la reconnaissance vocale IA, le taux d’erreur est réduit et même des termes techniques sont correctement retranscrits. Certains systèmes proposent en plus des corrections automatiques et de l’autocomplétion, tout en s’adaptant progressivement aux habitudes de langage de l’utilisateur.

Transcription

Les solutions de transcription transforment automatiquement des contenus audio ou vidéo en texte. Elles sont particulièrement utiles pour les conférences, podcasts ou réunions. L’ASR analyse les pistes audio, segmente les interventions et produit des transcriptions exploitables. Les entreprises bénéficient ainsi d’une meilleure documentation, d’un archivage simplifié et d’un gain de temps significatif.

Assistants vocaux

Les assistants vocaux comme Siri, Alexa ou Google Assistant interprètent les commandes vocales et y répondent en temps réel. Ils permettent de contrôler des appareils, d’organiser des tâches ou d’accéder à des informations. Ces systèmes combinent reconnaissance vocale IA et traitement du langage naturel pour comprendre le contexte et garantir des interactions fluides.

Assistants téléphoniques IA

La reconnaissance vocale IA joue un rôle central dans les assistants téléphoniques intelligents. Ces systèmes comprennent les demandes des appelants, les transcrivent en temps réel et y répondent automatiquement. Un exemple concret est le réceptionniste IA de IONOS : il permet de réduire les temps d’attente, d’améliorer l’expérience client et de soulager les équipes.

Grâce à leur intégration dans les infrastructures existantes, ces solutions sont rapidement opérationnelles et peuvent être personnalisées selon les besoins. Elles illustrent le potentiel de la reconnaissance vocale IA pour optimiser les processus métier au quotidien.

- Prend des rendez-vous, conseille, transfère des appels

- Répond immédiatement, jour et nuit

- Intégration facile dans les systèmes existants

- Essai gratuit

Quelles solutions de reconnaissance vocale IA choisir et quels sont leurs défis ?

Parmi les principales solutions de reconnaissance vocale IA figurent notamment :

- l’API Google Speech-to-Text

- Microsoft Azure Speech

- Amazon Transcribe

- OpenAI Whisper

Ces solutions se distinguent par leur couverture linguistique, leur précision, leurs capacités en temps réel et leurs modèles de tarification. Google offre une large couverture linguistique et une intégration étroite au Cloud. Microsoft met l’accent sur les usages en entreprise et la sécurité. Amazon Transcribe propose des solutions de streaming adaptées aux centres d’appels. Whisper se démarque par sa robustesse, par exemple dans des environnements bruyants. La plupart de ces outils sont accessibles via des API, facilitant leur intégration dans des applications existantes.

Le choix dépend des besoins spécifiques en matière linguistique, de traitement en temps réel et de protection des données.

Quels sont les défis et les limites de la reconnaissance vocale IA ?

Malgré ses performances, la reconnaissance vocale IA n’est pas exempte d’erreurs. Les homophones, les dialectes ou une articulation imprécise peuvent entraîner des confusions. Les bruits de fond et les limitations techniques compliquent également l’analyse. De plus, les termes spécialisés ou les noms propres ne sont pas toujours reconnus correctement.

Pour améliorer la précision, plusieurs approches sont utilisées : entraînement sur des jeux de données plus larges et variés, apprentissage continu, réduction du bruit et adaptation des modèles de langage à des contextes spécifiques. Les boucles de feedback, où les corrections sont réintégrées dans le système, permettent d’optimiser les performances. La combinaison de l’ASR et du NLP joue donc ici un rôle clé.

Comment assurer la protection des données et la conformité au RGPD avec la reconnaissance vocale IA ?

La reconnaissance vocale IA traite des données personnelles sensibles, comme la voix ou le contenu des conversations, ce qui rend la protection des données essentielle. Les entreprises doivent informer clairement sur les données collectées, leur utilisation et leur durée de conservation. Les enregistrements doivent être chiffrés et protégés contre les accès non autorisés.

Dans la mesure du possible, les données doivent être anonymisées ou pseudonymisées. Le consentement des utilisateurs est requis avant tout traitement des enregistrements vocaux. Pour les solutions Cloud, il est également important de vérifier la localisation des serveurs ainsi que les normes de sécurité appliquées.

Le réceptionniste IA de IONOS répond à ces exigences : les données sont traitées conformément au RGPD et hébergées exclusivement sur des serveurs situés dans l’Union européenne. Cela garantit un haut niveau de sécurité et renforce la confiance des clients.

Depuis le 1er août 2024, la réglementation européenne sur l’IA (AI Act) encadre l’utilisation des systèmes d’intelligence artificielle selon une approche basée sur les risques. Selon le niveau de risque, différentes obligations en matière de transparence, de gouvernance et de documentation s’appliquent.