Crawler : comment ces robots d’indexation optimisent Internet ?

Les crawlers sont la raison pour laquelle les moteurs de recherche tels que Google, Bing, Yahoo et DuckDuckGo fournissent toujours de nouveaux résultats de recherche actualisés. À la façon d’une araignée, ces bots parcourent le Web, collectent des informations et les enregistrent dans des index. Mais quelles sont les autres utilisations des Web crawlers et quels types de crawlers existent dans le World Wide Web ?

- Améliorez votre classement sur Google sans les frais d'une agence

- Répondez aux avis clients et générez des publications pour les réseaux

- Aucune connaissance en référencement et marketing en ligne requise

Qu’est-ce qu’un crawler ?

Les crawlers (ou robots d’indexation) sont des bots qui parcourent Internet à la recherche de données. Ils analysent les contenus et enregistrent les informations dans des bases de données et des index pour améliorer la performance des moteurs de recherche. Par ailleurs, ils collectent des données de contact et de profil à des fins marketing.

Comme les crawlers parcourent le Web (et toutes ses ramifications) à la recherche d’informations à la façon d’une araignée, ils sont également désignés sous le nom de spider bots. Basé sur le langage de programmation PERL, le premier robot d’indexation s’appelait World Wide Web Wanderer (abrégé en : WWW Wanderer). À partir de 1993, WWW Wanderer a mesuré la croissance d’Internet, encore récent à l’époque, et a enregistré les données collectées dans le premier index Internet Wandex.

Les crawlers sont essentiels pour le référencement naturel (SEO). Il est donc crucial pour les entreprises de comprendre les différents types et fonctions des Web crawlers afin de proposer des contenus optimisés pour le SEO en ligne.

Comment fonctionne un crawler ?

À l’instar des social bots et des chatbots, les robots d’indexation sont également composés d’un code incluant des algorithmes et des scripts qui attribue des tâches et des commandes précises. Le crawler répète les fonctions définies dans le code de façon autonome et continue.

Les robots d’indexation naviguent sur le Web en suivant les hyperliens des sites existants. Pour analyser de nouveaux sites Internet, ils évaluent les mots-clés et les hashtags, indexent les contenus et les URL de chaque site Internet, copient les pages Web et ouvrent toutes les URL trouvées ou uniquement une sélection d’URL. Par ailleurs, les crawlers vérifient l’actualité des liens et la structure des codes HTML.

À l’aide d’outils d’analyse Web spécifiques, les Web crawlers peuvent analyser les informations telles que les consultations de pages et les liens ainsi que collecter des données ou les comparer de façon ciblée (par exemple pour les portails de comparaison) dans le cadre d’un data mining.

Les moteurs de recherche et les crawlers spécialisés utilisent de plus en plus l’intelligence artificielle et le traitement automatique du langage naturel (NLP) pour mieux comprendre les contenus Web, non seulement sur le plan technique, mais aussi en termes de contenu. Ainsi, les crawlers modernes peuvent analyser des relations sémantiques, la pertinence des sujets ou encore la qualité des textes.

Quels types de crawlers existe-t-il ?

Il existe différents types de Web crawlers, chacun ayant des objectifs et une portée spécifiques.

Crawlers de moteurs de recherche

Les Web crawlers les plus souvent utilisés sont les searchbots de Google ou d’autres moteurs de recherche comme Yahoo, Bing ou DuckDuckGo. Ils consultent, collectent et indexent le contenu du Web afin d’optimiser la portée et la base de données des moteurs de recherche. Les noms des Web crawlers les plus connus sont :

- GoogleBot (Google)

- Bingbot (Bing)

- DuckDuckBot (DuckDuckGo)

- Baiduspider (Baidu)

- Yandex Bot (Yandex)

- Sogou Spider (Sogou)

- Exabot (Exalead)

- GPTBot (OpenAI)

- ClaudeBot (Anthropic)

Crawlers de sites Web personnels

Simples dans leurs fonctionnalités, ces petits crawlers peuvent être utilisés par des entreprises individuelles pour réaliser des tâches spécifiques. De cette façon, elles peuvent par exemple surveiller la fréquence de certains mots-clés ou l’accessibilité de certaines URL.

Crawlers de sites Web commerciaux

Les crawlers commerciaux sont des solutions logicielles complexes d’entreprises proposant les Web crawlers à titre d’outils payants. Ils offrent davantage de services et de fonctionnalités, permettant aux entreprises de gagner du temps et de l’argent en évitant de développer leur propre crawler.

Crawlers de sites Web sur le Cloud

De plus, on trouve des robots d’indexation de sites Web qui enregistrent les données sur le Cloud plutôt que sur un serveur local, et qui sont généralement proposés sous forme de services par des entreprises informatiques. Du fait de leur indépendance vis-à-vis des ordinateurs locaux, les outils d’analyse et les bases de données peuvent être utilisés par n’importe quel appareil à l’aide des données d’accès correspondantes et leur application est modulable.

Crawlers de sites Web de bureau

Il est possible d’exécuter de petits Web crawlers sur un PC ou un ordinateur portable personnel. Généralement, ces robots d’indexation à l’utilité très limitée, mais peu coûteux, peuvent uniquement analyser de petites quantités de données et de sites Internet.

Crawlers mobiles

Les mobile crawlers analysent les sites Web tels qu’ils apparaissent sur smartphones et tablettes. Depuis l’adoption de l’indexation Mobile-First par Google, ces crawlers jouent un rôle crucial dans le classement des pages. Ils peuvent, par exemple, détecter des problèmes d’affichage et les évaluer en conséquence.

Crawlers basés sur l’intelligence artificielle

Les AI crawlers sont des crawlers Web basés sur l’intelligence artificielle. Ils sont utilisés par les entreprises pour analyser, évaluer les contenus Web ou pour l’entraînement de grands modèles linguistiques (LLM). Contrairement aux bots de moteurs de recherche classiques, ces crawlers ne se contentent pas d’indexer les sites, mais comprennent les contenus à un niveau sémantique, extraient des connaissances et les utilisent pour améliorer les modèles.

Comment procèdent les crawlers en pratique ?

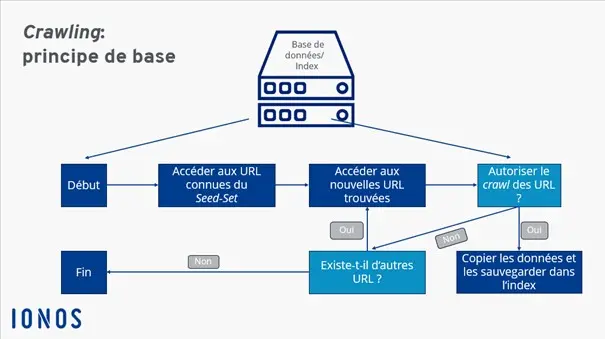

La procédure concrète suivie par un Web crawler comporte plusieurs étapes :

- Crawl frontier : les moteurs de recherche définissent dans une structure de données appelée crawl frontier si le robot d’indexation doit rechercher de nouvelles URL via des sites Internet connus et indexés ainsi que via des liens indiqués dans les plans de site, ou si seuls des sites Internet et des contenus spécifiques doivent être explorés.

- Seed-Set : les crawlers reçoivent un seed-set du moteur de recherche ou de l’entité qui les a commandés. Il s’agit d’une liste d’adresses Web et d’URL connues ou à explorer. Cette liste est basée sur les indexations, les bases de données et les plans de site utilisés jusqu’à présent. Les crawlers parcourent cet ensemble jusqu’à ce qu’ils rencontrent des boucles ou des liens morts.

- Complément de l’index : en analysant le seed, les crawlers peuvent évaluer de nouveaux contenus Web et les ajouter à l’index. Ils actualisent les anciens contenus ou suppriment de l’index les URL et les liens lorsqu’ils n’existent plus.

- Fréquence du crawling : bien que les crawlers parcourent le Web sans interruption, les programmeurs peuvent déterminer à quelle fréquence ils devront visiter et analyser les URL. Pour ce faire, ils analysent la performance des pages, la fréquence des mises à jour et le trafic de données. En se basant sur ces données, les programmeurs définissent la demande en indexation.

- Gestion de l’indexation : les administrateurs des sites Internet peuvent exclure les visites de leur site Internet par les crawlers de façon ciblée. Cette exclusion est permise par des protocoles robots.txt ou des balises HTML

nofollow. Lors de la consultation d’une URL, les robots d’indexation reçoivent ainsi l’instruction d’éviter un site Internet ou d’analyser uniquement les données de façon limitée.

Depuis 2020, Google ne considère plus l’attribut nofollow comme une instruction stricte, mais uniquement comme un indicateur pour l’évaluation des liens. Cela signifie que Google peut, dans certains cas, crawler et indexer des liens nofollow. Pour les propriétaires de sites Web, cela signifie que si vous souhaitez vraiment exclure du crawling certains contenus, il est recommandé d’utiliser le fichier robots.txt ou la balise noindex.

Quels sont les avantages d’un robot d’indexation ?

✓ Avantageux et efficace : les Web crawlers assurent des tâches d’analyse chronophages et coûteuses et peuvent scanner, analyser et indexer le contenu du Web de façon plus rapide, avantageuse et complète que les êtres humains.

✓ Utilisation simple et vaste portée : les robots d’indexation peuvent être implémentés rapidement et simplement et garantissent une collecte et une analyse des données complète et continue.

✓ Amélioration de la réputation en ligne : les crawlers permettent d’optimiser votre marketing en ligne en analysant et en se focalisant sur votre propre clientèle. D’autre part, les crawlers peuvent améliorer la réputation en ligne d’une entreprise en enregistrant les modèles de communication sur les réseaux sociaux.

✓ Publicité ciblée : le data mining et une publicité ciblée permettant de toucher des groupes de clients spécifiques. Les sites Internet avec une fréquence de crawling élevée apparaissent plus haut dans les moteurs de recherche et sont davantage consultés.

✓ Analyse des données d’entreprise et des données client : grâce aux robots d’indexation, les entreprises peuvent évaluer et analyser les données des clients et des entreprises disponibles en ligne ainsi que les utiliser pour leur marketing et leur stratégie d’entreprise.

✓ Optimisation SEO : en analysant les termes de recherche et les mots-clés, il est possible de définir des mots-clés focus limitant la concurrence et augmentant les consultations du site.

D’autres domaines d’application sont :

- La surveillance continue de systèmes afin de trouver des points faibles

- L’archivage d’anciens sites Internet

- La comparaison de sites Internet mis à jour avec d’anciennes versions

- La détection et la suppression de liens morts

- L’examen du volume de recherche par mot-clé

- La détection de coquilles et d’autres contenus erronés

Comment augmenter la fréquence de crawling d’un site Internet ?

Si vous souhaitez que votre site Internet apparaisse le plus haut possible dans les moteurs de recherche et soit régulièrement visité par les Web crawlers, vous devriez faciliter autant que possible l’accès des bots à votre site Internet. Les sites permettant une fréquence de crawling élevée bénéficient d’une priorité plus importante dans les moteurs de recherche. Les facteurs suivants sont décisifs pour qu’un site Internet puisse être facilement trouvé par les crawlers :

- Le site Internet propose différents liens vers d’autres pages et est mis en lien sur d’autres sites Internet. De cette façon, les crawlers ne trouvent pas uniquement votre site Internet via des liens et peuvent utiliser votre site Internet comme un nœud de circulation permanent plutôt que comme une voie à sens unique.

- Le contenu du site Internet doit être constamment actualisé et mis à jour. Cela concerne les contenus, les liens et le code HTML.

- L’accessibilité du serveur doit être garantie.

- Le temps de chargement du site Internet doit être correct.

- Le site ne doit pas comporter de liens et de contenus en double ou superflus.

- Le sitemap, le fichier robots.txt et l’en-tête HTTP Response doivent fournir les principales informations sur le site Internet.

Web crawler et scraper : quelle est la différence ?

Bien qu’ils soient souvent assimilés, les Web crawlers et les scrapers n’appartiennent pas au même type de bots. Alors que les Web crawlers recherchent en premier lieu les contenus du Web, les enregistrent dans des index et les évaluent, les scrapers ont avant tout pour tâche d’extraire les données des sites Internet via le Web scraping.

Bien qu’il existe des points communs entre un crawler et un scraper et que les robots d’indexation soient utilisés pour le Web scraping en copiant et en enregistrant les contenus du Web, leur fonction principale consiste à consulter les URL, analyser les contenus et compléter l’index avec de nouveaux liens et de nouvelles URL.

À contrario, les scrapers ont pour fonction première de visiter des URL spécifiques pour extraire des données spécifiques des sites Internet et les enregistrer dans des bases de données pour une utilisation ultérieure.